一、方法简介

无差别数据投毒攻击及对抗防御对保障无监督学习等人工智能安全十分重要。**新研究表明,其中无监督对比学习易于遭受数据投毒攻击的风险,攻击者通过将毒物添加到干净预训练数据集进行投毒。为此,本文提出一种基于对比学习的预训练编码器无差别数据投毒攻击方法(IDPA),该方法不同于现有的以数据集作为攻击对象,而是以整个模型为目标,同时定义两个损失函数,即攻击有效性损失和模型有效性损失,实现无差别数据投毒攻击的双重优化问题。

图1 所提IDPA方法

图2 攻击优化目标细节

本文所提出的IDPA攻击方法包含两个步骤,一是毒化预训练编码器,二是构建下游分类器并输出,如图1所示。此外,本文要实现两个目标,包括攻击有效性和模型有效性,如图2所示。为了实现攻击有效性的关键目标,通过将输入样本预测为错误的样本类别,中毒的编码器将为输入样本和锚图像产生相似的特征向量。同时,IDPA要保持由毒化编码器构建的下游分类器的准确性,以达成模型有效性的另一关键目标。

二、实验结果

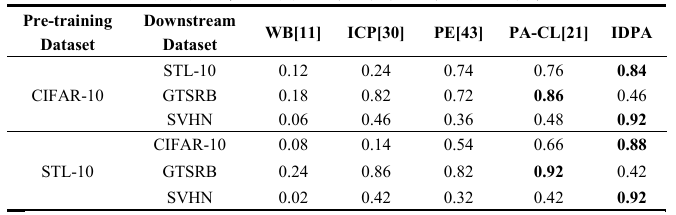

本文进行了系统广泛的实验,评估IDPA在四个包含真实世界数据集上的有效性。其中一项对比研究,如表 1显示了不同预训练数据集和下游数据集上的ASR。实验结果表明,本文所提出的IDPA能够实现更高的ASR。当下游数据集为SVHN时,IDPA可以达到92%的ASR。此外,本文使用多种防御方法证明IDPA具有良好的鲁棒性。

表 1在不同的预训练数据集和下游数据集进行对比分析

三、论文信息

相关论文《IDPA: Indiscriminate Data Poisoning Attacks Targeting Pre-trained Encoder Based on Contrastive Learning》已被ACM Transactions on Privacy and Security(TOPS 2025)接受,作者是河南科技大学的胡奥迪、张志勇(通讯作者)、权高原、岳欣馨。

原文链接:https://dl.acm.org/doi/10.1145/3757916